OpenAI Sfiducia Nvidia con un Modello di Codifica Fulmineo su Chip Cerebras

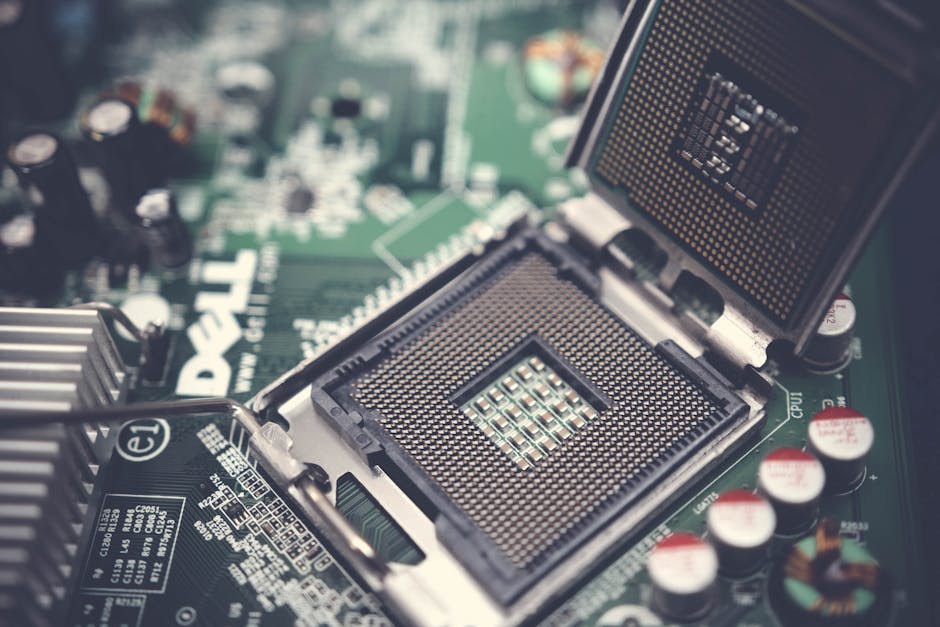

OpenAI ha compiuto un passo audace nel mondo dell’intelligenza artificiale, rilasciando il suo primo modello di AI progettato per funzionare su hardware non Nvidia. La mossa, che vede l’implementazione del nuovo modello di codifica GPT-5.3-Codex-Spark su chip Cerebras, segna un momento significativo nella corsa all’innovazione nel settore.

Velocità Senza Precedenti

Il modello Codex-Spark si distingue per la sua straordinaria velocità, capace di elaborare codice a oltre 1.000 tokens al secondo. Questa performance è circa 15 volte superiore a quella del suo predecessore, un balzo quantico che promette di rivoluzionare il modo in cui i programmatori interagiscono con gli strumenti di intelligenza artificiale. Per fare un confronto, il modello Claude Opus 4.6 di Anthropic, nella sua modalità veloce a pagamento, raggiunge circa 2,5 volte la sua velocità standard di 68,2 tokens al secondo, sebbene sia un modello più grande e capace di Spark. “Cerebras è stato un ottimo partner di ingegneria, e siamo entusiasti di aggiungere l’inferenza veloce come una nuova capacità della piattaforma”, ha dichiarato Sachin Katti, responsabile del calcolo presso OpenAI.

Disponibilità e Funzionalità

Codex-Spark è attualmente disponibile in anteprima per gli abbonati a ChatGPT Pro ($200 al mese) tramite l’app Codex, l’interfaccia a riga di comando e l’estensione VS Code. OpenAI sta gradualmente estendendo l’accesso API a partner selezionati. Il modello è dotato di una finestra di contesto di 128.000 tokens e, al momento del lancio, gestisce solo testo. Questa versione si basa sul modello completo GPT-5.3-Codex, lanciato da OpenAI all’inizio del mese. Mentre il modello completo è progettato per compiti di codifica complessi, OpenAI ha ottimizzato Spark per la velocità, a scapito della profondità di conoscenza. Il modello è stato costruito esclusivamente per il testo e specificamente per la codifica, non per le attività generiche gestite dalla versione più grande di GPT-5.3.

Prestazioni e Confronti

Secondo OpenAI, su SWE-Bench Pro e Terminal-Bench 2.0, due benchmark per la valutazione delle capacità di ingegneria del software, Spark supera il precedente GPT-5.1-Codex-mini, completando i compiti in una frazione del tempo. L’azienda non ha condiviso una validazione indipendente di questi numeri. In passato, la velocità di Codex è stata un punto debole; quando Ars ha testato quattro agenti di codifica AI che costruivano cloni di Minesweeper a dicembre, Codex ha impiegato circa il doppio del tempo rispetto a Claude Code di Anthropic per produrre un gioco funzionante.

La Corsa agli Agenti di Codifica AI

La velocità di 1.000 tokens al secondo di GPT-5.3-Codex-Spark rappresenta un notevole progresso rispetto a qualsiasi cosa OpenAI abbia precedentemente offerto tramite la propria infrastruttura. Secondo benchmark indipendenti di Artificial Analysis, i modelli più veloci di OpenAI su hardware Nvidia raggiungono un massimo ben inferiore a tale cifra GPT-4o offre circa 147 tokens al secondo, o3-mini raggiunge circa 167 e GPT-4o mini si attesta a circa 52. Tuttavia, 1.000 tokens al secondo sono in realtà modesti per gli standard di Cerebras. L’azienda ha misurato 2.100 tokens al secondo su Llama 3.1 70B e ha riportato 3.000 tokens al secondo sul modello gpt-oss-120B open-weight di OpenAI, suggerendo che la velocità relativamente inferiore di Codex-Spark riflette l’overhead di un modello più grande o complesso. Gli agenti di codifica AI hanno avuto un anno di successo, con strumenti come Codex di OpenAI e Claude Code di Anthropic che hanno raggiunto un nuovo livello di utilità per la costruzione rapida di prototipi, interfacce e codice boilerplate. OpenAI, Google e Anthropic sono in competizione per fornire agenti di codifica più capaci, e la latenza è diventata ciò che separa i vincitori; un modello che codifica più velocemente consente a uno sviluppatore di iterare più velocemente.

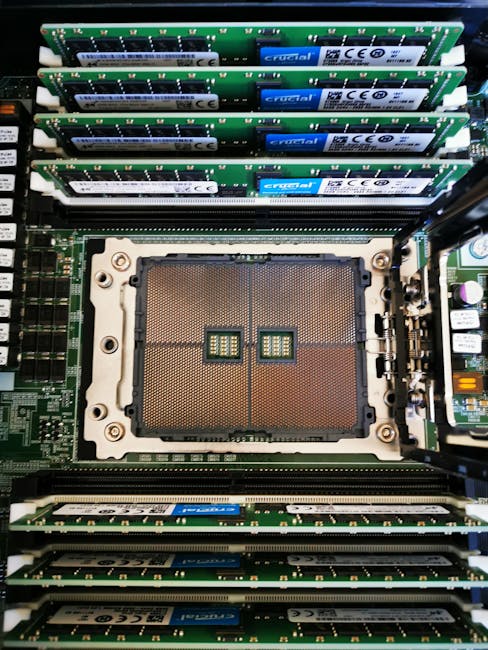

Diversificazione e Strategia Hardware

La storia dell’hardware di Spark potrebbe essere più significativa dei suoi punteggi di riferimento. Il modello funziona su Wafer Scale Engine 3 di Cerebras, un chip delle dimensioni di un piatto che Cerebras ha costruito attorno al suo business almeno dal 2022. OpenAI e Cerebras hanno annunciato la loro partnership a gennaio, e Codex-Spark è il primo prodotto a derivarne. OpenAI ha trascorso l’ultimo anno riducendo sistematicamente la sua dipendenza da Nvidia. L’azienda ha firmato un accordo pluriennale con AMD nell’ottobre 2025, ha stretto un accordo di cloud computing da 38 miliardi di dollari con Amazon a novembre e ha progettato il proprio chip AI personalizzato per l’eventuale fabbricazione da parte di TSMC. Nel frattempo, un accordo infrastrutturale da 100 miliardi di dollari con Nvidia è finora fallito, sebbene Nvidia si sia impegnata a un investimento da 20 miliardi di dollari. Reuters ha riferito che OpenAI è cresciuta insoddisfatta della velocità di alcuni chip Nvidia per le attività di inferenza, che è esattamente il tipo di carico di lavoro per cui OpenAI ha progettato Codex-Spark. Indipendentemente dal chip utilizzato, la velocità è importante, sebbene possa avvenire a scapito dell’accuratezza. Per gli sviluppatori che trascorrono le loro giornate all’interno di un editor di codice in attesa di suggerimenti AI, 1.000 tokens al secondo potrebbero sembrare meno come pilotare con attenzione un puzzle e più come utilizzare una sega a strappo. Basta guardare cosa stai tagliando.